Global Sites

有害ボイスチャット自動検出機能「Safe Voice」発表。Unityが手がける、AIによる“有害な言動”自動検出・分類システム

Unityは7月13日、「Safe Voice」のクローズドベータ版を配信開始した。ゲーム内音声コミュニケーションを分析し、有害なボイスチャットでの言動を自動で検出することができる機能だ。

Unity Technologies(以下、Unity)は7月13日、「Safe Voice」のクローズドベータ版を配信開始した。本機能では、ゲーム内音声コミュニケーションを分析し、有害なボイスチャットでの言動を自動で検出することができる。Unityゲーミングサービスへ新機能として導入されるようだ。

Unityは、アメリカを拠点とするテクノロジー企業。同社が手がけるゲームエンジン「Unity」は、PC・コンソール・モバイルなど幅広いプラットフォーム向けの、さまざまな規模やジャンルのゲームタイトル制作に利用されている。また同社はゲーム開発・運営支援向けの「Unityゲーミングサービス」も提供している。同サービスには多様な機能が揃っており、ゲームの開発からリリース後の運用までに必要なものがひとつのサービスにまとめられている。

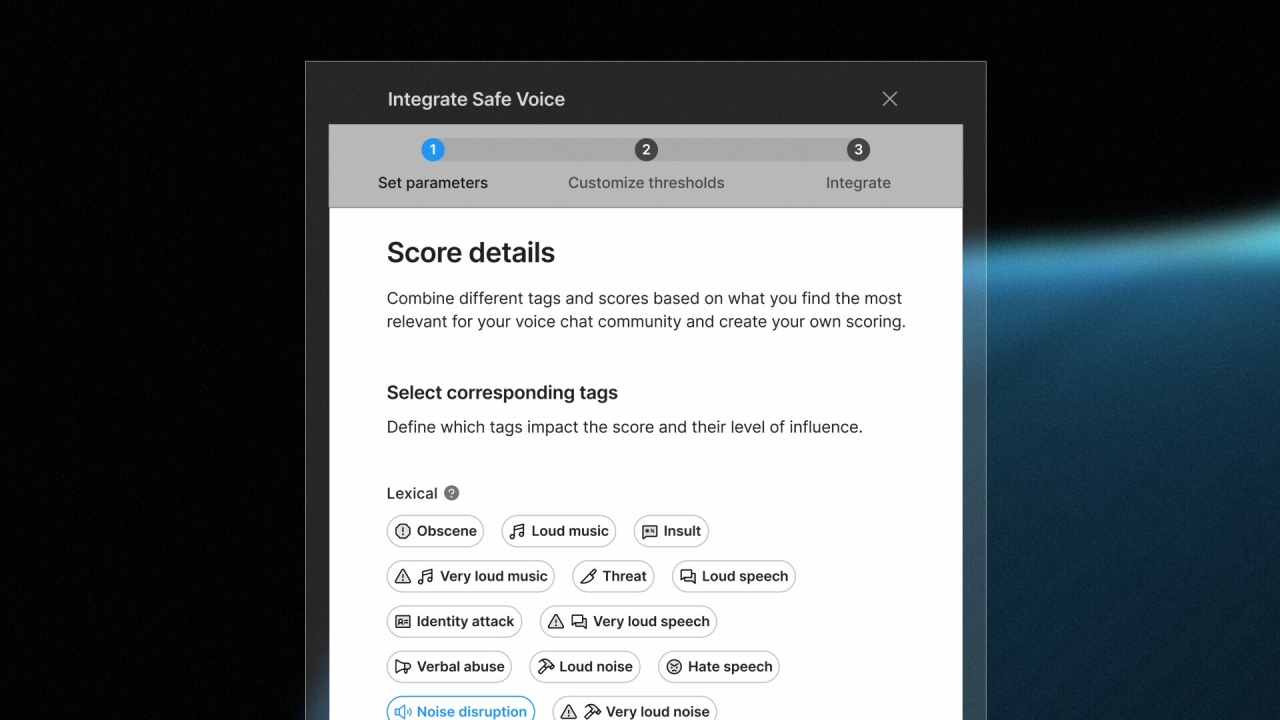

今回発表された「Safe Voice」は、このUnityゲーミングサービスの新機能としてクローズドベータで導入されるようだ。本機能では、ゲーム内音声コミュニケーションを分析し、ゲーム内のプレイヤーによる有害な行為を検出することができる。具体的にはゲーム内ボイスチャットから、トーン、音量、ピッチ、イントネーション、感情、プレイヤー間でのやり取りの文脈など、それぞれの音声特性を分析する。そこから音声の乱れが特定されると、十数種類のカテゴリー(わいせつ、脅迫、侮辱、個人攻撃など)に分類された上で“有害な行為”が検出される。以上の検出・分類プロセスはAIにより自動でおこなわれ、分析結果がほぼリアルタイムで提供されるようだ。これにより、有害な行為へ迅速な対応を取ることができるようになるだろう。

一方、ゲームジャンルによっては有害な行為の認識が異なる場合も考えられる。Safe Voiceではそれぞれのコミュニティ文化に合わせて、有害な行為の範囲をカスタマイズすることができるようだ。たとえば特定の語句に関して、その有害性を高く設定したり、逆に対応の優先順位を下げたりすることもできる。コミュニティの文化を維持しながら、健全なゲーム環境を築くことに役立つだろう。

また本機能では、注意が必要なセッションを分類し、に優先順位を付けられるとのこと。プレイヤーがミュートしていたり、退出していたり、弱い立場のプレイヤーが参加していたりと、プレイヤーたちのボイスチャットやゲームへの参加状態を検出できるそうだ。そうした中から優先順位を設定できるため、有害行為への対応に必要なリソースを減らすことも可能だとされている。

またSafe Voiceには、プレイヤー間でのやり取りに関する情報を一覧で表示する、ダッシュボード機能も搭載。時系列でトレンドが表示され、ゲーム内で最も問題を起こしている行為を読み取ることができるようだ。なお本機能は、『VALORANT』『レインボーシックスシージ』などに用いられているUnityのボイスチャット機能「Vivox」に対応している。

Unity公式サイトのQ&Aによると、Safe Voiceはゲームエンジンに依存せず、Unreal Engineやその他エンジンでも利用できるとのこと。また、PC/PlayStation/Xbox/Android/iOSなどの主要なゲームプラットフォームに対応するようだ。

オンラインゲームにおいては、ボイスチャット・テキストチャットなどにおける有害な言動が問題視されることがしばしばある。各タイトルで独自の通報機能・検出機能が開発されている中、ゲームエンジンを問わず幅広く利用可能できそうな「Safe Voice」はそうした開発の手間を省いてくれる機能となるかもしれない。正式運用に向けた今後の動向も注目される。

「Safe Voice」は、Unity公式サイトよりクローズドベータ版として提供中だ。

この記事にはアフィリエイトリンクが含まれる場合があります。